Proyectos

Sistemas en producción y escalables. No MVP.

Telecomunicaciones

Ecosistema de IA para operaciones telecom

Un carrier telecom necesitaba unificar su operación de campo, monitoreo de red, gestión de sitios, KPIs y priorización en una sola plataforma. Operaban con 6+ sistemas desconectados, procesos manuales en Excel, y operadores que perdían 15 minutos por consulta navegando entre aplicaciones. Resultado: el tiempo de consulta operacional bajó de 15 minutos a menos de 2 segundos. La productividad del centro de control aumentó porque los operadores dejaron de copiar datos entre sistemas y empezaron a tomar decisiones con información consolidada en tiempo real.

Backend (338K lines)

backend-api · FastAPI · 138K lines

backend-engine · Python · 200K lines

│

Frontend (98K lines)

frontend-web · Node.js + Express + EJS

Chart.js · WebSocket · SSE

│

AI Layer (38K lines)

mcp-server · Claude

65 tools · 13 módulos · MCP

│

+6 componentes auxiliares

WhatsApp relay · criticality engine

panel · reportes · sistema de sitios · monitoreo de red

Arquitectura del ecosistema

12 componentes en producción. 476K líneas. FastAPI + Node.js + PostgreSQL + Docker.

Métricas de producción

Datos reales del sistema operando para un carrier telecom líder.

API + Engine

338K líneas Python sobre FastAPI. Gestión de miles de tareas de campo diarias, priorización multi-factor por criticidad (SLA, antigüedad, impacto, zona), tracking GPS de técnicos via field service, integración con gestión de sitios y monitoreo de red. API REST con 200+ endpoints.

Frontend Web

98K líneas Node.js + Express con server-side rendering. Dashboard operacional en tiempo real con Chart.js. WebSocket para push updates. Panel de priorización interactivo. Mapa GPS de técnicos. Interfaz responsive para uso en centro de control 24/7.

Asistente IA Chat + MCP

38K líneas. Claude orquestando 65 herramientas en 13 módulos. Entity extraction con Haiku (~200ms). Ejecución paralela con asyncio.gather(). Anti-hallucination guardrails. Circuit breaker. WhatsApp para equipos en terreno via Twilio relay. Certificado 123/123 tests en 19 categorías.

MCP: Model Context Protocol

Primer MCP de Telecom en Chile orquestado por IA en lenguaje natural

Desarrollamos un servidor MCP que conecta Claude AI directamente a toda la infraestructura operacional del cliente. Operadores preguntan "¿cuáles son las tareas críticas estancadas del sitio SITE-001?" y reciben respuesta en 2 segundos. Antes: 6 aplicaciones, 15 minutos.

tasks ····· 20 (search, SLA, timeline)

tasks_extra · 10 (aging, stalled, stats)

kpis ······ 16 (realtime, MTTR, mgmt)

field ······ 12 (GPS, distance, assign)

panel ····· 11 (filter, summary, check)

sites ······· 11 (sites, history, autorización de acceso)

analysis ··· 5 (briefing, classify)

network ···· 5 (site health, alarms)

email ····· 4 (send, list, access auth)

health ···· 4 (system, monitors)

whatsapp ·· 3 (send, group)

monitors ·· 3 (status, alerts)

quick ····· 1 (datetime)

13 módulos de herramientas

Cada módulo agrupa tools por dominio operacional.

in: "tareas críticas SITE-001"

│

NLP (Haiku ~187ms)

pop: SITE-001 · criticality: 1

│

tools (parallel)

→ critical_stalled 340ms

→ panel_summary 220ms

│

out: 3 tareas · 1.4s total

guardrails: clear

Pipeline de ejecución

De pregunta en lenguaje natural a respuesta con datos reales en <2 segundos.

Anti-hallucination

Tool calls obligatorios

2-stage correction

│

Write protection

dry_run=true default

Confirm en msg separado

│

Circuit breaker

5 failures → OPEN 60s

│

Loop detector

Max 5 identical · Max 4 errors

Guardrails de seguridad

Multi-capa: anti-hallucination, write protection, circuit breaker, loop detection.

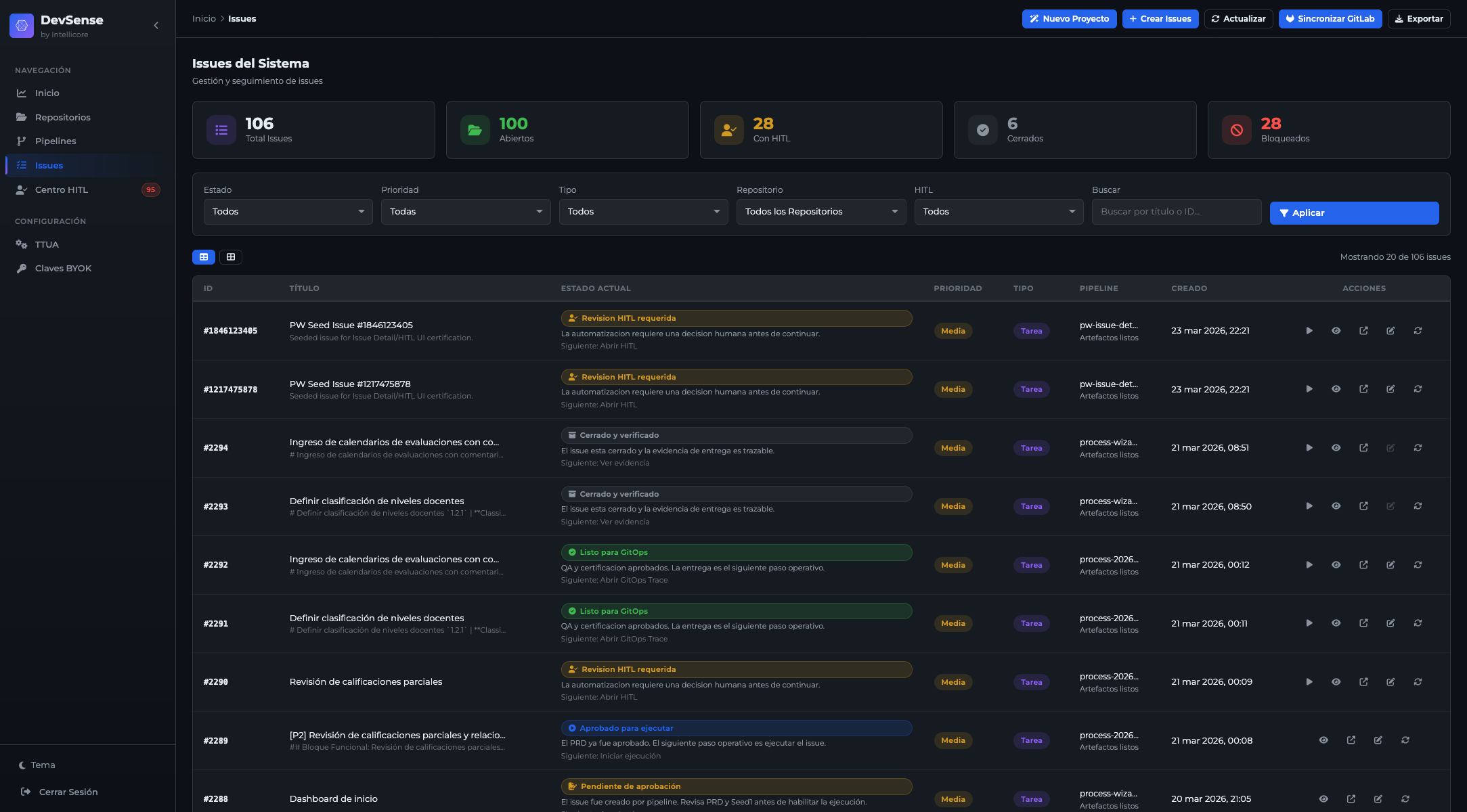

Educación · AI-Driven

Adaptación de Plataforma Educativa de código abierto a Production-Grade con DevSense

Adaptación de plataforma educativa de código abierto para 3 sedes con requerimientos distintos. Gestión académica, calificaciones, inscripciones, calendarios, y autenticación con SSO gubernamental. Resultado: la plataforma se entregó en 10 semanas (vs. 6+ meses estimados por otro proveedor). Las 3 sedes operan de forma independiente sobre una base de código compartida, lo que redujo costos de mantenimiento en más de un 60%.

branches

base → módulos comunes

sede-1 → extensiones específicas

sede-2 → extensiones específicas

sede-3 → extensiones específicas

│

CI/CD

lint → SAST → test → build

→ container scan → deploy

│

Imágenes Docker por rama

Reproducibles y portables

Branching multi-sede

Rama base compartida + ramas específicas. Cero modificación al core de ERP.

$ devsense process --project academias

│

✓ Categorías docentes · 23m

✓ Calificaciones parciales · 47m

✓ Plazos por etapa · 31m

✓ Descarga de material · 19m

✓ Tabulación Excel · 52m

✓ Setup Docker base · 68m

│

6/6 PASS · 3 auto-healed

DevSense en acción

Issues procesados automáticamente con sandbox validation y auto-healing.

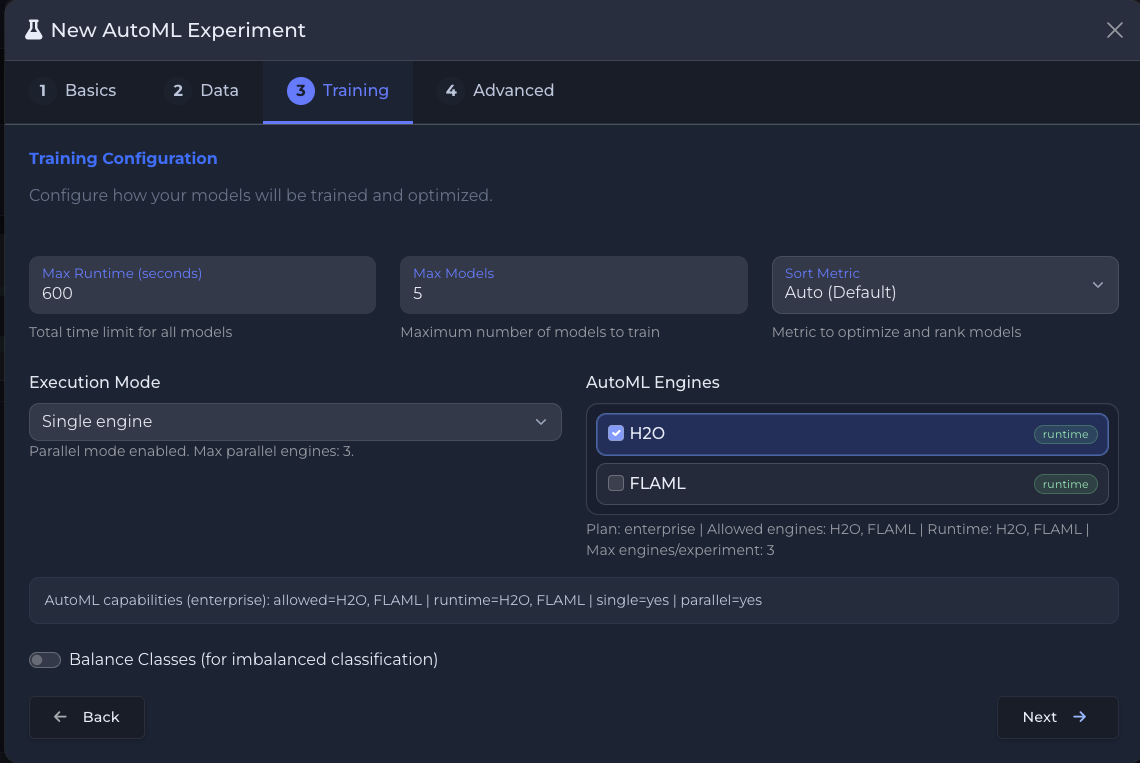

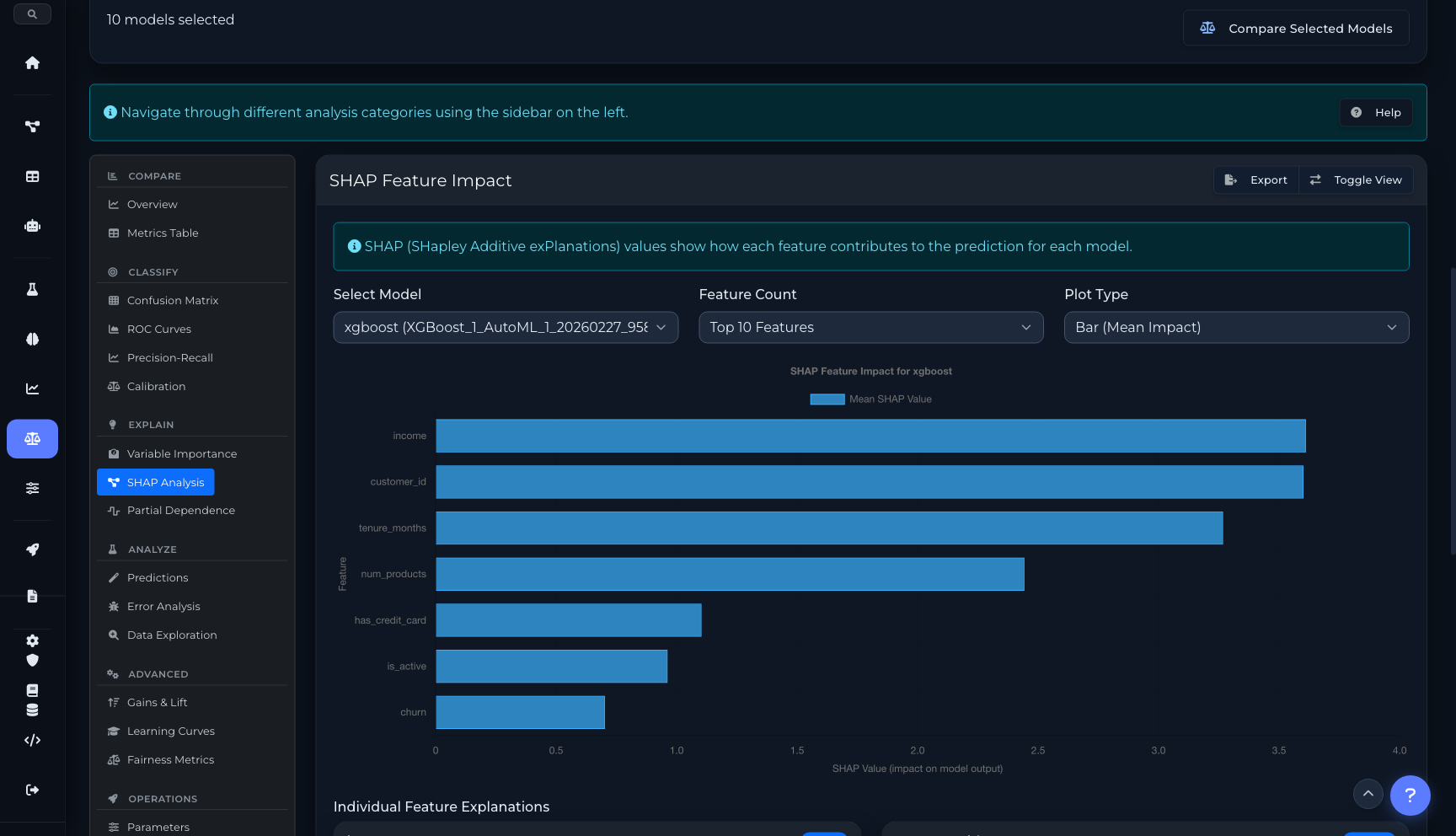

CorePlexML - Machine Learning Platform

Desarrollo de CorePlexML con DevSense

La plataforma de Machine Learning que necesitábamos y que no existía como producto integrado. Permite a equipos sin especialistas en ML subir datos, entrenar modelos automáticamente, desplegarlos en producción con monitoreo, y cumplir normativas de privacidad. Resultado: empresas que antes necesitaban un equipo de data science de 3-4 personas ahora operan ML con 1 analista usando CorePlexML. Del dato crudo al modelo en producción en menos de 1 hora.

H2O.ai y FLAML compitiendo en paralelo con leaderboard en tiempo real

Explicabilidad: contribución de cada feature a las predicciones

PASS ml_engineer_meta 85/85 · PASS triple_parity 71/71

PASS ui_component 52/52 · PASS playwright_stress 34/34

PASS studio_stress 48/48 · PASS synthgen 21/21

PASS multi_automl 11/11 · PASS builder 32/32

PASS data_parity 14/14 · PASS semantic 19/19

PASS ui_api_parity 49/49 · PASS platform 126/126

│

Total: 562/562 · GO

Certificación de calidad

12 gates independientes. Paridad triple, stress testing, auditoría semántica. Decisión: GO.

Modernización · DevOps

GitLab on-premise + containerización + CI/CD enterprise

Implementación de GitLab on-premise para clientes enterprise que requieren control total de código y pipelines. Migración de aplicaciones legacy a Docker/Podman sin downtime. Adaptación de soluciones open-source a ambientes productivos con health checks, Prometheus, Grafana, y documentación operacional auto-generada. Blue-green deployments. Let's Encrypt SSL automático. Container scanning con Trivy.

stages:

analyze: lint · SAST · secrets · deps

test: Docker + functional + integration

build: multi-stage image por rama

scan: Trivy container scanning

deploy: blue-green → production

│

infra: GitLab self-hosted · Docker registry privado

monitoring: Prometheus + Grafana

ssl: Let's Encrypt automático

Pipeline CI/CD enterprise

GitLab CI con SAST, container scanning, y deploy blue-green automatizado.

¿Tienes un proyecto similar?

Proyectos entregados en semanas en vez de meses, operaciones que pasaron de 15 minutos a 2 segundos, costos de mantenimiento reducidos en más de 60%. Contáctanos y evaluamos tu caso.

Agendar reunión