Metodología

AI-Driven Software Development Lifecycle

Cada ingeniero de AsyncLabs es un equipo de desarrollo en sí mismo

No vendemos agilidad. No vendemos cascada. No vendemos horas de desarrollo. Vendemos resultados en producción ejecutados con un modelo donde la inteligencia artificial hace el 70% del trabajo mecánico (generación de código, testing, documentación, seguridad, CI/CD) y el ingeniero humano hace el 30% que realmente requiere juicio experto: arquitectura, decisiones de negocio, y validación final.

El resultado: un ingeniero de AsyncLabs produce lo que un equipo tradicional de 4-5 personas. No porque trabaje más horas, sino porque el motor AI elimina la fricción que consume el 60-70% del tiempo de un desarrollador: boilerplate, debugging de errores, documentación retroactiva, configuración de entornos, code reviews sobre código que debería haberse generado automáticamente.

AI-Driven Software Development Lifecycle

Desarrollo tradicional vs.

AI-Driven

No es una mejora incremental. Es un cambio de modelo. La diferencia no está en trabajar más rápido, está en que la mayor parte del trabajo lo ejecuta un motor automatizado con validación continua, y el humano se enfoca en lo que realmente importa.

| Desarrollo tradicional | AI-Driven SDLC | |

|---|---|---|

| Proyecto mediano (500 req) | 6–9 meses, equipo de 5-8 | 4–6 semanas, equipo de 1-2 + AI |

| Costo estimado | USD $150K–$300K | USD $40K–$80K |

| Cobertura de tests | 40-60% (si hay tiempo) | +95% automático desde el día 1 |

| Documentación | Manual, se desactualiza en semanas | Auto-generada, siempre al día |

| Análisis de seguridad | Auditoría externa al final | SAST en cada commit (bandit + semgrep) |

| Time to first deploy | 3-4 meses | 2-3 semanas |

| Dependencia de personas clave | Alta (si se va el senior, se va el conocimiento) | Baja (el conocimiento está en el pipeline y los repos) |

| Escalamiento | Lineal: más gente = más coordinación | Exponencial: más proyectos, mismo equipo |

| Operación 24/7 | No (turnos costosos) | Sí (el motor AI no duerme) |

| QA visual | Manual o inexistente | Automatizado con Midscene (pixel-perfect) |

Ahorro estimado: 73% · USD $165K

Ahorro por proyecto

Comparativa de costo total para un proyecto mediano (500 requerimientos). Incluye desarrollo, QA, documentación y despliegue.

Reducción: 83% · 6+ meses antes en producción

Tiempo de entrega

Timeline comparativo para el mismo alcance. El modelo AI-Driven comprime 6-9 meses en 4-6 semanas.

El modelo

Cómo funciona, paso a paso

No es "Copilot con esteroides". Es un pipeline de ejecución completo donde el requerimiento entra por un extremo y sale un Feature Request en GitLab con código, tests, SAST y documentación listos para review. Si algo falla en el camino, el sistema diagnostica, reintenta con estrategias diferentes, y escala al humano solo cuando no puede resolver por sí mismo.

INPUT

"Agregar endpoint de KPIs en tiempo real con filtros por zona y período"

OUTPUT

Tipo: API endpoint · Módulo: KPIs

Archivos: 3 (route, service, test)

Dependencias: 0 · Estimado: 23 min

Análisis y planificación

El requerimiento se clasifica semánticamente, se descompone en tareas ejecutables, y se estima automáticamente.

Generación + Testing

Código y tests generados juntos, no como afterthought. Coverage y SAST verificados antes del MR.

⚠ Test 6 failed: Bad file descriptor

[DECISION] Check container health

[RESULT] Transient error, retry

│

✓ Test 1-5: PASS

✓ Test 6 (retry): PASS

│

Resolution: auto-healed

Human intervention: not needed

Auto-healing + QA vNext + Human in the Loop

Si los tests fallan, el sistema diagnostica y reintenta. Si no puede resolver, escala con contexto completo a un humano en el proceso.

Roles

Qué hace la IA.

Qué hace el humano.

La IA no reemplaza al ingeniero. Le quita el trabajo que no debería estar haciendo para que haga el que sí importa. La división es clara y relevante.

La IA ejecuta

→Generación de código desde requerimientos en lenguaje natural

→Tests unitarios, de integración y E2E generados junto al código

→Análisis de seguridad SAST en cada commit (bandit, semgrep)

→Documentación OpenAPI, diagramas de arquitectura, READMEs

→CI/CD pipeline completo: lint → test → sast → build → deploy

→Auto-healing: diagnóstico, retry con estrategias diferentes, rollback

→QA visual con Midscene (comparación pixel-perfect de screenshots)

→Refactoring automatizado cuando detecta code smells

El humano decide

→Diseño de arquitectura: qué servicios, cómo se comunican, qué escala

→Decisiones de negocio: priorización, trade-offs, scope de cada release

→Code review final: validar que el output cumple el estándar del proyecto

→Definición de criterios de aceptación y edge cases no obvios

→Relación con el cliente: entender el problema real, no solo el requerimiento

→HITL (Human-in-the-Loop): resolver lo que el auto-healer no puede

→Validación de UX: flujos, experiencia de usuario, sentido común

→Decisiones de seguridad que requieren contexto de negocio

Calidad

No entregamos código. Entregamos sistemas certificados.

Cada entrega pasa por el mismo framework de certificación de calidad que usamos para nuestras plataformas internas. No es QA convencional, es un sistema de gates independientes diseñados para encontrar problemas antes de que lleguen a producción.

+95%

Coverage de tests automático

0

Vulnerabilidades SAST en cada merge

100%

Documentación auto-generada y al día

Triple

Paridad verificada: UI ↔ API ↔ DB

Testing desde el día 1

Cada feature se genera con sus tests (unitarios, integración, E2E). No es un target que se persigue al final del sprint; es un output automático. Si el coverage baja de 90%, el pipeline falla y el motor corrige.

SAST en cada commit

bandit + semgrep analizan cada cambio antes del merge. Vulnerabilidades OWASP Top 10, SQL injection, XSS, path traversal, detectados y bloqueados automáticamente. Cero vulnerabilidades es el estándar, no la aspiración.

Certificación de calidad

El mismo framework con el que certificamos CorePlexML. Gates de paridad triple (UI/API/DB), visual stress con Playwright, perfiles de auditoría simulando ingenieros senior intentando romper el sistema. GO/NO-GO basado en evidencia.

STACK ASYNCLABS

El stack que habilita el modelo

La metodología AI-Driven no funciona con ChatGPT y copy-paste. Requiere plataformas específicas que orquesten LLMs, gestionen pipelines de ejecución, y garanticen calidad a escala. Construimos las nuestras.

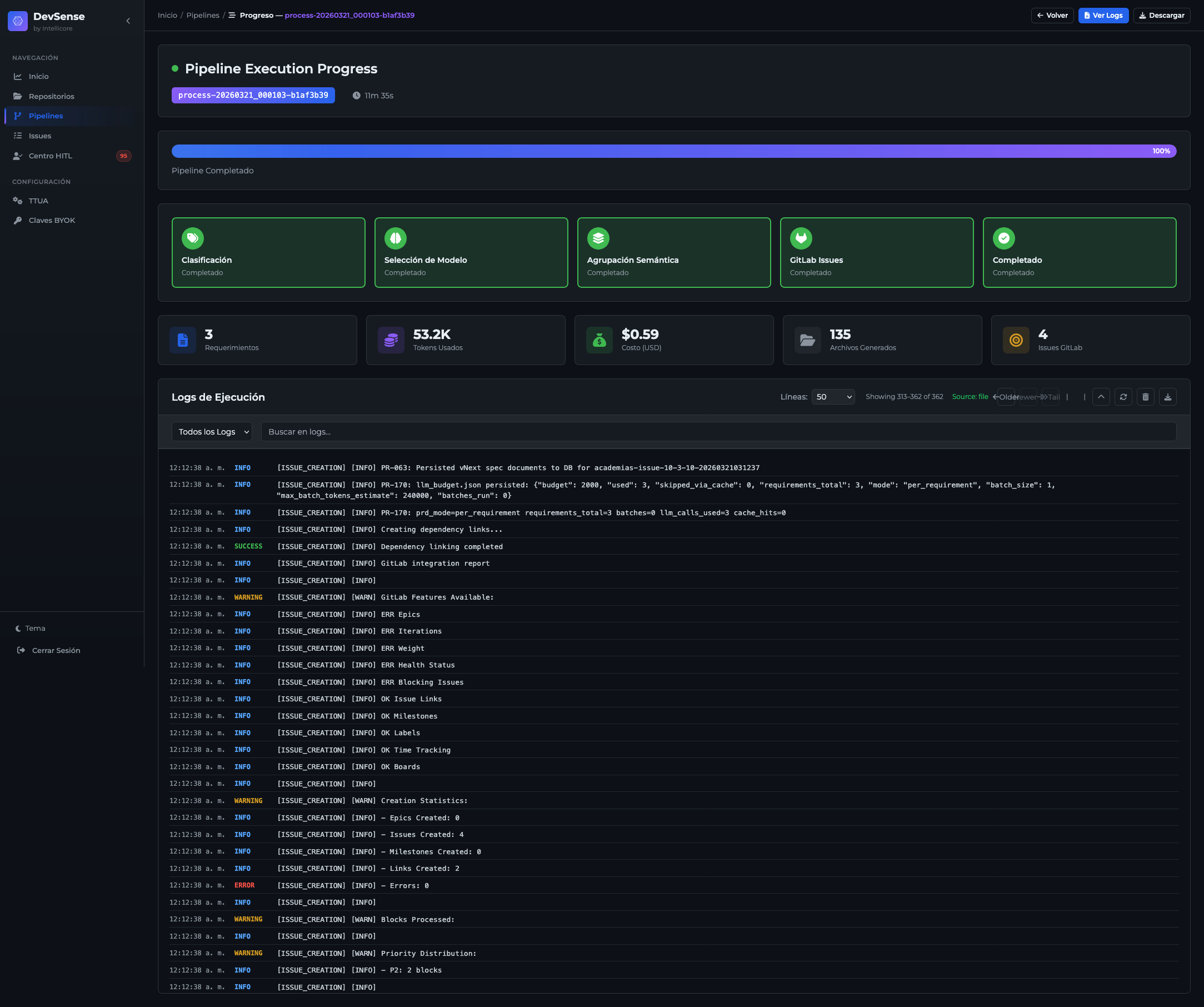

DevSense: motor de desarrollo autónomo

Automatiza el ciclo completo de desarrollo de software. De requerimiento en lenguaje natural a Feature Request en GitLab con tests, SAST y documentación. Multi-LLM (Claude, GPT, Gemini) con cross-validation. Auto-healing con 4 niveles de retry + HITL. QA visual con Midscene. Sandbox aislado en Docker para cada ejecución. Se construye a sí mismo desde el Sprint 4, más del 90% de sus features son auto-generadas.

Ver DevSense en detalle →CorePlexML: motor de machine learning

Cubre el ciclo completo de machine learning. Dataset Builder AI conversacional, AutoML multi-engine (H2O + FLAML), evaluación SHAP, MLOps con canary deployments, Privacy Suite (55+ PII, GDPR/HIPAA), SynthGen, What-If Studio. Certificada para producción enterprise. SDK en Python. Disponible como SaaS o implementación on-premise.

Ver CorePlexML en detalle →LLMs

Claude · GPT · Gemini

Cross-validation entre modelos

│

Desarrollo

DevSense · GitLab CI · Docker

pytest · bandit · semgrep · Midscene

│

ML & Data

CorePlexML · H2O.ai · FLAML

SHAP · CTGAN · LangGraph

│

Integración

MCP · FastAPI · PostgreSQL

Redis · Qdrant · httpx HTTP/2

Ecosistema AI-Driven

Stack completo que soporta la metodología. Cada componente tiene un rol específico en el pipeline.